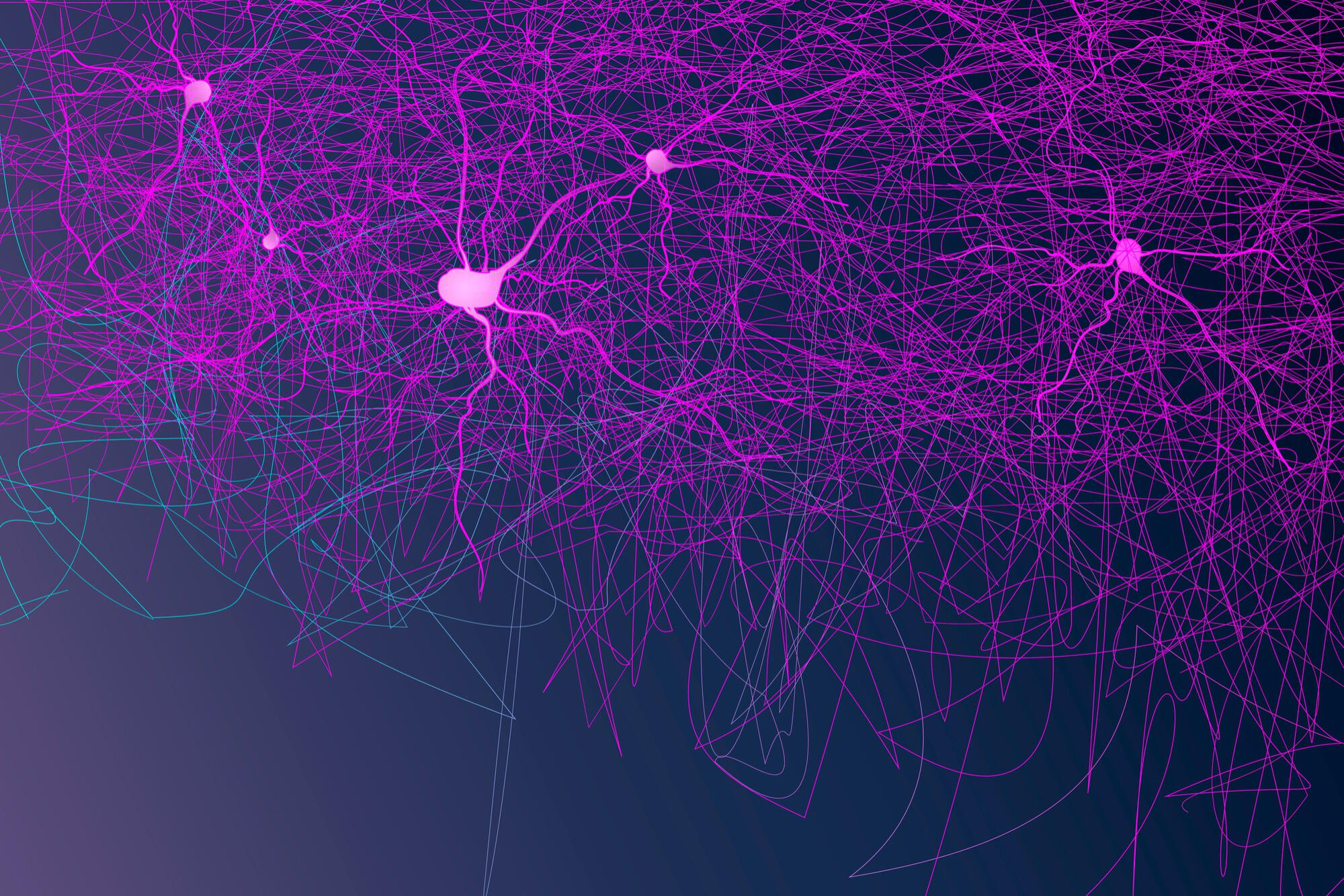

As redes neurais artificiais fazem parte da IA, ou seja, do segmento da inteligência artificial. As redes neurais das máquinas apresentam grandes semelhanças com os neurônios biológicos, uma vez que existem camadas de nós interconectados.

Essas redes neurais são treinadas através de dados para que gerem resultados com precisão. Além disso, elas são constantemente aperfeiçoadas para que os sistemas se tornem "cada vez mais inteligentes". Com isso, as redes neurais desempenham a função de categorizar as informações. Dito isso, vamos entender mais sobre as redes neurais artificiais?

O que são redes neurais artificiais?

Uma rede neural, também conhecida como rede neural artificial, é um tipo de algoritmo de aprendizado de máquina inspirado no cérebro biológico

Michael Taylor

As redes neurais artificiais são modelos de aprendizado máquina (Machine Learning) que apresentam semelhanças com o cérebro humano, e fazem parte da inteligência artificial (IA). Os processos executados pelas redes neurais artificiais são bem parecidos com o funcionamento dos neurônios biológicos.

A partir das redes neurais, os dados são processados pelos computadores de forma parecida com o cérebro humano. Dessa forma, as redes neurais detectam fenômenos, analisam as possibilidades e fazem as suas próprias conclusões.

As redes neurais são fazem parte do Machine Learning, ajudando no processo de "aprendizado profundo" da máquina.

Na rede neural, os nós ficam interconectados em camadas, parecendo a "estrutura" do cérebro humano.

Para que funcionem de forma eficiente, as redes neurais apresentam um sistema adaptativo. Através desse sistema, as máquinas aprendem quando erram, buscando se aperfeiçoar no processo.

No mais, as redes neurais são eficientes na resolução de problemas complexos.

Dessa forma, as redes neurais permitem que os computadores tomem decisões inteligentes. Tais redes são formadas por camadas de nós interconectados, também chamados pelos especialistas como "neurônios artificiais".

Essas camadas de nós apresentam a seguinte estrutura: 1 camada de entrada ➡️ 1 ou mais camadas ocultas ➡️ 1 camada de saída. Esses nós são conectados uns com os outros e apresentam as suas próprias características.

Para que as redes neurais apresentem precisão, essas precisam ser treinadas a partir de dados. Após o ajuste necessário, as redes neurais desempenham uma tarefa importante no universo da inteligência artificial (IA). Afinal, com a assistência das redes neurais, os dados são classificados e agrupados com bastante eficiência. Vamos saber mais sobre o machine learning?

Como funcionam as redes neurais?

O funcionamento da rede neural se baseia no funcionamento do cérebro humano. Isso significa que a arquitetura da rede neural é parecida com a do nosso cérebro. No nosso cérebro, o processamento de informações ocorre através do envio de sinais elétricos pela rede de neurônios interconectados.

A rede neural funciona da mesma forma: a rede neural artificial é composta de neurônios artificiais interconectados que processam as informações. Esses neurônios artificiais são módulos de software; e as redes neurais artificiais são algoritmos de software ou programas, os quais funcionam a partir de sistemas de computação.

As redes neurais precisam ser treinadas para que essas executem tarefas específicas. Tal aprendizado se dá pelo processamento de um grande volume de dados - sejam rotulados ou não rotulados. Dessa forma, os dados são processados com maior eficiência e precisão.

Um dos tipos de treinamentos mais utilizados é o "aprendizado supervisionado", em que um grande volume de dados rotulados é fornecido para a rede neural, com o compartilhamento da resposta correta de forma antecipada.

Com esse conjunto de dados, a rede neural adquire conhecimento sobre o assunto específico, sendo treinada continuamente até que os resultados gerados sejam eficientes. Vale ressaltar que, para que esses modelos matemáticos sejam treinados e testados, é necessária a existência de um código fonte. Através do código fonte se transforma a teoria em aplicações reais.

Arquitetura de rede neural simples

A rede neural simples (ou básica) é formada por interconexão de neurônios artificiais em três camadas; camada entrada, camada oculta e camada saída. Vamos conhecer melhor essas camadas rede neural, e a arquitetura de rede neural simples?

Camada de entrada

A camada de entrada é por onde as informações e os dados "entram" na rede neural. Os nós, que fazem parte da camada de entrada, realizam o processamento, a análise e a categorização dos dados, os enviando para a camada oculta.

Camada oculta

A camada analisa, processa e envia os dados recebidos da camada de entrada ou de outra camada oculta. Isso porque as redes neurais artificiais podem conter muitas camadas ocultas. Os dados são enviados para a camada de saída ou para outras camadas ocultas.

Camada de saída

A camada de saída processa todos os dados recebidos e gera o resultado final. Para isso, essa camada apresenta um ou vários nós. A camada de saída é a última, uma vez que essa é a responsável pela entrega do resultado.

Arquitetura neural profunda

A arquitetura neural profunda contém várias camadas ocultas. Essas camadas ocultas apresentam milhões de neurônios artificiais interconectados. Essa interconexão entre os neurônios (ou conexão entre nós) são representadas por pesos (que são números).

Se determinados nós tiverem a ação de excitar outro nós, os pesos serão representados por um número positivo; e se nós específicos tiverem a ação de reprimir outros nós, os pesos serão representados por um número negativo.

Quanto maiores os números desses pesos, maiores serão as influências dos nós sobre outros nós. Isso significa que os pesos (e valores) são importantes dentro da arquitetura rede neural. Após aprender isso, vamos entender sobre engenharia de prompt?

Tipos de redes neurais

Existem dois tipos principais de redes neurais; e esses possuem diferentes objetivos. Essas redes neurais se chamam "redes neurais convolucionais" e "redes neurais recorrentes". Vamos conhecer melhor essas duas classificações de rede neural, ou melhor, esses tipos redes neurais?

Redes neurais convolucionais (CNNs)

As redes neurais convolucionais, as CNNs, processam dados em forma de grade. Para que ocorra tal processamento, essas redes usam camadas convolucionais. Essas camadas usam filtros sobre a imagem com o objetivo de identificar determinadas características, como formas e texturas.

Uma curiosidade é que as redes neurais usam uma base matemática para executar os seus processos: a da álgebra linear. As principais operações realizadas são a multiplicação de matrizes e convoluções. Assim, esse tipo de rede neural é aplicada no reconhecimento de imagens, no reconhecimento padrões em documentos visuais e na visão computacional.

Redes neurais recorrentes (RNNs)

As redes neurais recorrentes "trabalham" com dados sequenciais, apresentando loops de feedback. Esses loops possibilitam que os outputs de uma etapa do processo exerçam influência sobre os inputs da próxima etapa. Isso permite que as etapas futuras "lembrem" dos processamentos de etapas anteriores.

As redes neurais recorrentes foram criadas para processar dados sequenciais, pois memorizam informações anteriores através de conexões recorrentes

Nesse caso, se utiliza uma sequência de dados, o que permite que as redes neurais recorrentes sejam aplicadas em séries temporais, processamento linguagem natural (PLN) e previsões futuras. Esse tipo de rede neural é bastante utilizado para previsões, como previsões do tempo e previsões de vendas. Uma das redes neurais recorrentes mais conhecidas é a rede de Hopfield.

História das redes neurais

O início da história das redes neurais artificiais se deu a partir de pesquisas realizadas por estudiosos da área. Os primeiros pesquisadores foram Pitts e McCulloch, que relacionaram o funcionamento do cérebro humano com a lógica booleana. Veja como se deu a história das redes neurais a partir do seu processo evolutivo - desde 1943 até os dias atuais.

Origem das redes neurais

As redes neurais foram criadas a partir da vontade de simular o cérebro humano através dos sistemas computacionais. O objetivo foi criar uma máquina capaz de processar informações - assim como ocorre no cérebro humano.

O primeiro modelo matemático de neurônio artificial foi criado em 1943 pelos estudiosos Walter Pitts e Warren McCulloch. Eles criaram o neurônio a partir de somas ponderadas de entradas e função ativação binária. Assim, se deu origem às primeiras redes neurais artificiais.

Evolução das redes neurais

A ideia de criar uma "máquina que pensa" existe desde a Grécia Antiga. Mas, apenas na década de 40, se iniciou os estudos que levaram à evolução dos modelos redes neurais. Vamos ver como se deu essa evolução do modelo de aprendizagem ao longo das décadas?

1943

Walter Pitts e Warren S. McCulloch publicaram o artigo "A logical calculus of the ideas immament is nervous activity".

Essa publicação científica pesquisou sobre o funcionamento do cérebro humano, com ênfase na conexão entre células cerebrais (ou seja, os neurônios) e a sua produção de padrões complexos. Essa pesquisa resultou na comparação entre as conexões dos neurônios e a lógica booleana¹.

1958

Frank Rosenblatt criou o perceptron (a rede neural mais antiga da história)

Esse pesquisador publicou o artigo científico "The perceptron: a probabilistic model for information storage and organization in the brain", dando continuidade à pesquisa de Pitts e McCulloch. Com essa pesquisa, Frank Rosenblatt conseguiu desenvolver uma máquina capaz de diferenciar as cartas da esquerda e da direita, usando um IBM 704².

1974

Paul Werbos fez uma pesquisa sobre retropopagação e a sua aplicação nas redes neurais na tese de doutorado

Por mais que vários pesquisadores tivessem publicado artigos científicos sobre a retropopagação, Werbos foi o primeiro pesquisador que identificou a possibilidade de aplicação da retropopagação nas redes neurais, aplicando essa pesquisa em sua tese de doutorado.

1989

Yan Lecun publicou um artigo sobre como a integração das restrições na retropopagação, na arquitetura de rede neural, serve para o treinamento de algoritmos

Essa pesquisa de Lecun possibilitou que uma rede neural reconhecesse dígitos de códigos postais, que foram compartilhados pelo Serviço Postal dos Estados Unidos.

1990

Yan Lecun aplicou redes neurais convolucionais no reconhecimento de dígitos manuscritos

Esse projeto de Lecun para reconhecimento de dígitos manuscritos foi um projeto do cheque bancário, nos Estados Unidos³.

2006

Geoffrey Hinton aplicou técnicas de pré-treinamento para redes profundas

Esse pesquisador reacendeu o interesse pelos estudos em Deep Learning.

2014

Ian Goodfellow criou Redes Generativas Adversariais (GANs)

Durante o seu doutorado na Universidade de Montreal, Ian Goodfellow criou a arquitetura Generative Adversarial Networks (GANs), a qual transformou a era da IA generativa.

2017

Ashish Vaswani e o seu grupo de pesquisadores introduziram a arquitetura Transformer

A arquiterura Transformer se transformou no padrão-outro em NLP, que é o Processamento de Linguagem Natural.

Essa foi a evolução, ao longo dos anos, das redes neurais. A evolução desse tema se deu principalmente através da publicação de pesquisas científicas por diversos pesquisadores. Na década de 2020, os modelos de linguagem de larga escala foram lançados: GPT-3, ChatGPT (2022) e outras aplicações de IA. Inclusive, o GPT-3, lançado em 2020, foi, considerado na época, a maior rede neural de processamento de linguagem natural

de parâmetros

Além disso, houve a criação de hardwares especializados: GPUs otimizadas, TPUs e chips neuromórficos; e a expansão das redes multimodais, que integram áudio, imagem, texto e vídeo. É nesse momento da expansão das redes neurais que estamos hoje!

Atualmente, a rede neural artificial mais clássica - e básica - é a rede neural artificial Feedforward, a qua apresenta um fluxo unidirecional da camada de entrada para a camada de saída. Além desses redes neurais mais clássicas, também existem as redes neurais profundas, que são uma evolução das redes Feedforward. Essas redes neurais profundas chamam atenção por conter várias camadas ocultas.

E aí, gostou de obter mais conhecimento sobre redes neurais convolucionais e redes neurais recorrentes? Conseguiu entender quais são as suas camadas? Curtiu descobrir como é o seu funcionamento e processo treinamento? Se sim, comente e compartilhe e aprenda mais sobre linguagem de programação por aqui!

Referências Bibliográficas

- MCCULLOCH, Warren S.; PITTS, Walter. A logical calculus of the ideas immament is nervous activity. The Bulletin of Mathematical Biophysics, v.5 p.115-113, 1943.

- ROSENBLATT, Frank. The perceptron: a probabilistic model for information storage and organization in the brain. Psychological Review, v. 65, n. 6, p. 386-408, nov. 1958.

- LECUN, Yann; BOSER, Bernhard; DENKER, Jonh S.; HENDERSON, Donnie; HOWARD, Robert E.; HUBBARD, Wayne; JACKEL, Lawrence D. Backpropagation applied to handwritten zip code recognition. Neural Computation, v.1, n. 4, p. 541-551, dez. 1989.

Resumir com IA: